Samsung Capitaliza el Auge de la IA Elevando el Precio de su Memoria de Alta Tecnología

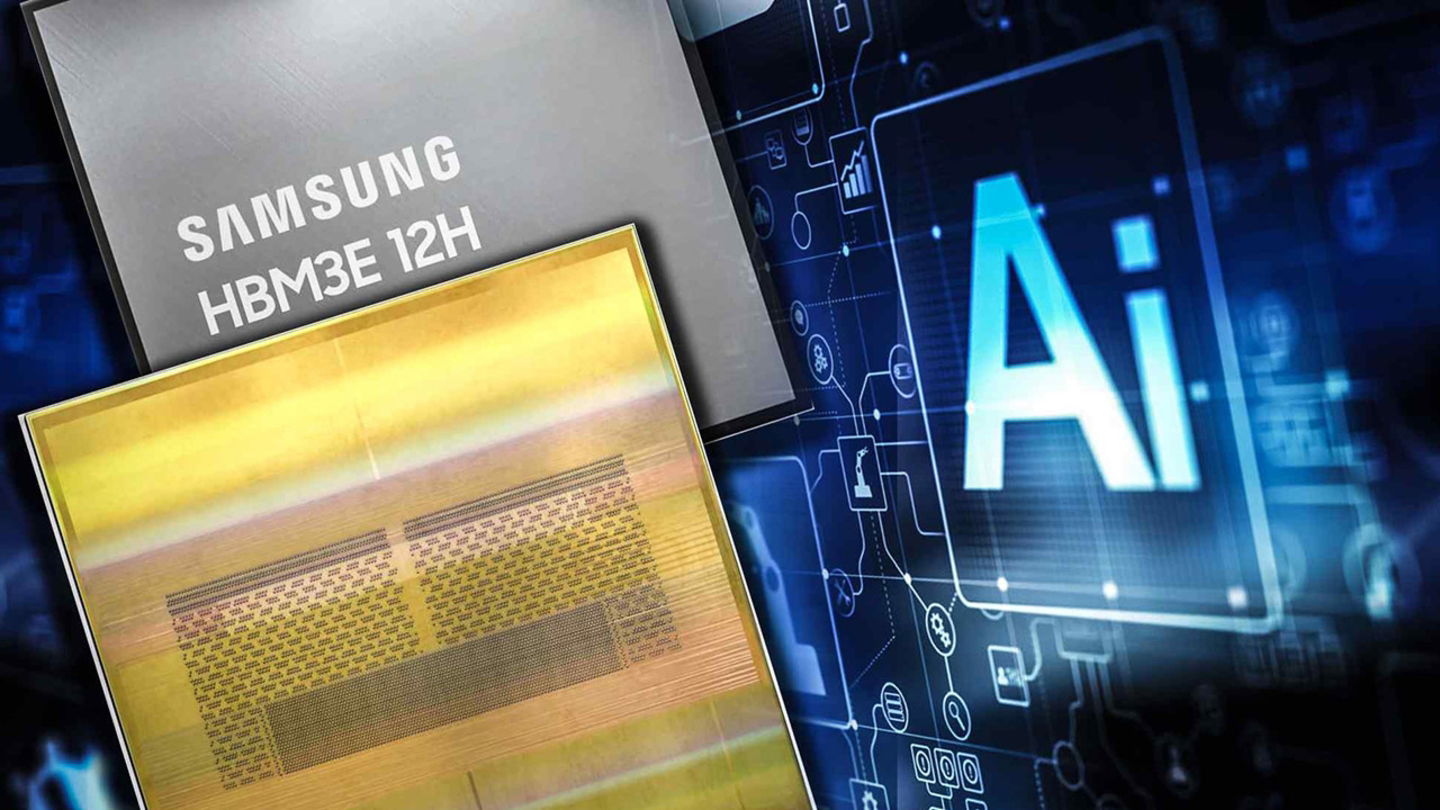

El entusiasmo por la inteligencia artificial no solo se refleja en nuevos modelos, asistentes más inteligentes o promesas de productividad ilimitada. También impacta profundamente en las bases de la industria. Samsung, uno de los líderes del mercado, ha tomado medidas al capitalizar la escasez de un componente esencial actual: la memoria de alto ancho de banda, o HBM.

Desde que plataformas como ChatGPT, Copilot y Gemini se integraron en la rutina diaria, la necesidad de infraestructura para IA ha explotado. Detrás de cada chatbot operan centros de datos llenos de aceleradores de IA, que dependen por completo de memorias de alta velocidad como la HBM3E.

El desafío radica en que esta memoria no se produce a gran escala: solo tres empresas en el mundo la fabrican en la actualidad, Micron, SK Hynix y la misma Samsung.

## Mayor Demanda, Oferta Estancada: La Combinación Ideal para Subidas

El desbalance era previsible. Mientras NVIDIA introduce aceleradores como el H200, que incorporan HBM3E, y naciones como China reanudan sus importaciones, la capacidad productiva apenas ha aumentado. Esto genera más pedidos, menor disponibilidad de chips y un incremento en los precios.

De acuerdo con diversas filtraciones de la industria, Samsung y SK Hynix han optado por elevar el precio de la HBM3E en aproximadamente un 20 %. No se trata de un ajuste temporal o fortuito, sino de una reacción estratégica a un mercado ansioso por garantizar el abastecimiento a cualquier costo.

Para Samsung, este momento es especialmente oportuno: la empresa está a punto de comenzar la producción de HBM4, una versión de nueva generación que, según evaluaciones internas de NVIDIA, se posiciona como la más veloz disponible.

## ¿Impacta Esto al Usuario Común?

Aquí surge la duda principal para muchos. En el corto plazo, no aparecerá un cargo extra en la factura de tu teléfono etiquetado como “recargo por IA”. La HBM no se emplea en smartphones, consolas o computadoras personales, sino en equipos para centros de datos. Aun así, el efecto no es nulo.

Los fondos y recursos se dirigen hacia la IA a un ritmo acelerado. Cuando resulta más rentable fabricar memoria avanzada que producir RAM o almacenamiento para el público general, las prioridades se reorientan.

Ya se ha observado cómo la demanda de los centros de datos ha presionado el mercado de componentes, incrementando los costos de servidores y, por efecto cadena, de ciertos productos para empresas y usuarios especializados. Además, los dispositivos que se lancen el próximo año llegarán con un ligero aumento en su precio.

Por otro lado, si los gastos para entrenar y ejecutar modelos de IA continúan en ascenso, estos costos se transferirán a servicios pagos, suscripciones más elevadas o características “premium” detrás de barreras de pago. No es un cambio inmediato, pero la conexión es evidente.

Mientras tanto, Samsung maneja una posición ventajosa. Con el precio de la HBM3E en alza, la HBM4 en desarrollo y acuerdos de fabricación con colosos como Apple y Tesla, la unidad de semiconductores de la firma surcoreana se enfrenta a un período particularmente rentable. La IA está transformando el panorama, y Samsung ha optado por cobrar por el acceso.

El artículo Samsung aprovecha el boom de la IA y sube el precio de su memoria más avanzada fue publicado originalmente en Andro4all.