Personas comparten sus casos legales con la IA, pero surge un problema cuando un juez las acepta como evidencia en un juicio

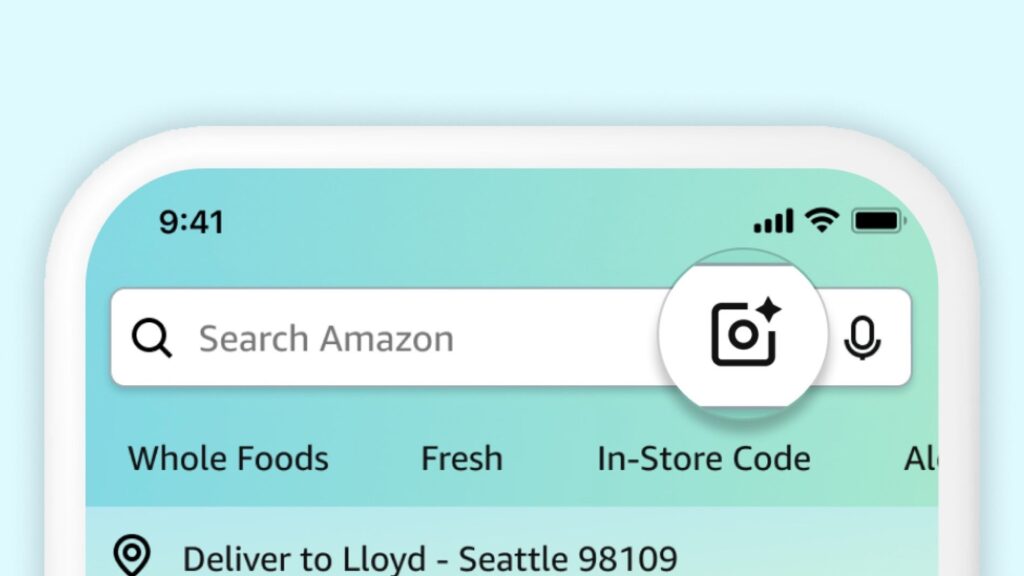

Cada vez más personas utilizan chatbots de IA como compañeros diarios, incluyendo herramientas como ChatGPT, Gemini o Claude. El inconveniente surge al compartir información sensible con estos sistemas, especialmente con modelos comerciales de grandes empresas tecnológicas, donde siempre existe incertidumbre sobre el destino de los datos.

En este contexto, algunos usuarios divulgan detalles legales con estos asistentes, lo que puede llevar a situaciones como la que ocurrió recientemente en Nueva York. Un juez de la ciudad ha establecido un precedente al determinar que las conversaciones con un chatbot son públicas y, por lo tanto, no gozan de la protección del privilegio abogado-cliente. Esto significa que cualquier dato compartido con la IA podría usarse en contra del usuario en un tribunal.

El caso

Bradley Heppner, un ejecutivo acusado de fraude por 300 millones de dólares, empleó Claude, el chatbot de Anthropic, para resolver dudas sobre su situación legal antes de su arresto. Generó 31 documentos basados en esas conversaciones y los compartió con sus abogados defensores. Cuando el FBI confiscó sus dispositivos electrónicos, los abogados argumentaron que esos documentos estaban protegidos por el privilegio abogado-cliente. Sin embargo, el juez Jed Rakoff rechazó esa afirmación.

Por qué no

Según comparte Moish Peltz, un abogado especializado en activos digitales y propiedad intelectual, en una publicación en X, la decisión judicial se basa en tres motivos principales:

- Una IA no es un abogado: carece de licencia para ejercer, no tiene lealtad hacia nadie y sus términos de servicio rechazan explícitamente cualquier relación abogado-cliente.

- Compartir información legal con una IA es equivalente a contársela a un amigo, por lo que no está amparada por el secreto profesional.

- Enviar documentos no privilegiados a un abogado posteriormente no los transforma en confidenciales de manera automática.

El problema de fondo

Como indica el abogado, la interfaz de estos chatbots crea una ilusión de privacidad, pero en realidad se introduce información en una plataforma comercial de terceros que retiene los datos y se reserva derechos amplios para divulgarlos. De acuerdo con la política de privacidad de Anthropic en vigor cuando Heppner usó Claude, la empresa puede revelar tanto las consultas de los usuarios como las respuestas generadas a “autoridades gubernamentales reguladoras”.

Dilema

El documento judicial también destaca un complicación adicional: Heppner ingresó en la IA información que había recibido previamente de sus abogados. Esto genera un dilema para la fiscalía, según explica Peltz. Si intentan utilizar esos documentos como evidencia en el juicio, los abogados defensores podrían convertirse en testigos, lo que podría llevar a la anulación del proceso.

Qué significa para ti

Si estás involucrado en cualquier asunto legal, esta sentencia implica que lo compartido con una IA puede ser requerido por un juez y empleado como prueba. No importa si se trata de preparar una defensa o buscar orientación inicial, ya que cada interacción podría volverse en contra. Esto no se limita a casos criminales: aplica a divorcios, disputas laborales, litigios comerciales y más; cualquier charla con IA sobre estos temas queda fuera de la protección legal.

Y ahora qué

Peltz indica que los profesionales legales deben alertar explícitamente a sus clientes sobre este riesgo, ya que no se puede dar por sentado que lo comprendan de forma intuitiva. La solución propuesta implica crear entornos colaborativos con IA compartidos entre abogado y cliente, de modo que cualquier interacción con la inteligencia artificial se realice bajo la supervisión del abogado y dentro de la relación abogado-cliente.

Imagen de portada | Romain Dancre y Solen Feyissa