La “Destrucción del Conocimiento”: La Ciencia se Inunda de Investigaciones Fantasma Generadas por la IA

Aunque se trataba de un riesgo previsible, no por ello resulta menos alarmante. El crecimiento de los modelos de inteligencia artificial multimodales ha llevado a que casi todos los usemos para mejorar la productividad o identificar las fuentes más confiables al buscar datos, considerando que chatbots como Claude, ChatGPT o Gemini se entrenan con acceso a gran parte del saber acumulado por la humanidad.

Sin embargo, esto mismo representa una amenaza para la IA, ya que, según reportaron recientemente colegas de la revista Rolling Stone, estos modelos han desarrollado la capacidad de falsear información y crear referencias ficticias para respaldar sus respuestas, con el fin de aparentar veracidad cuando en realidad proporcionan datos completamente erróneos.

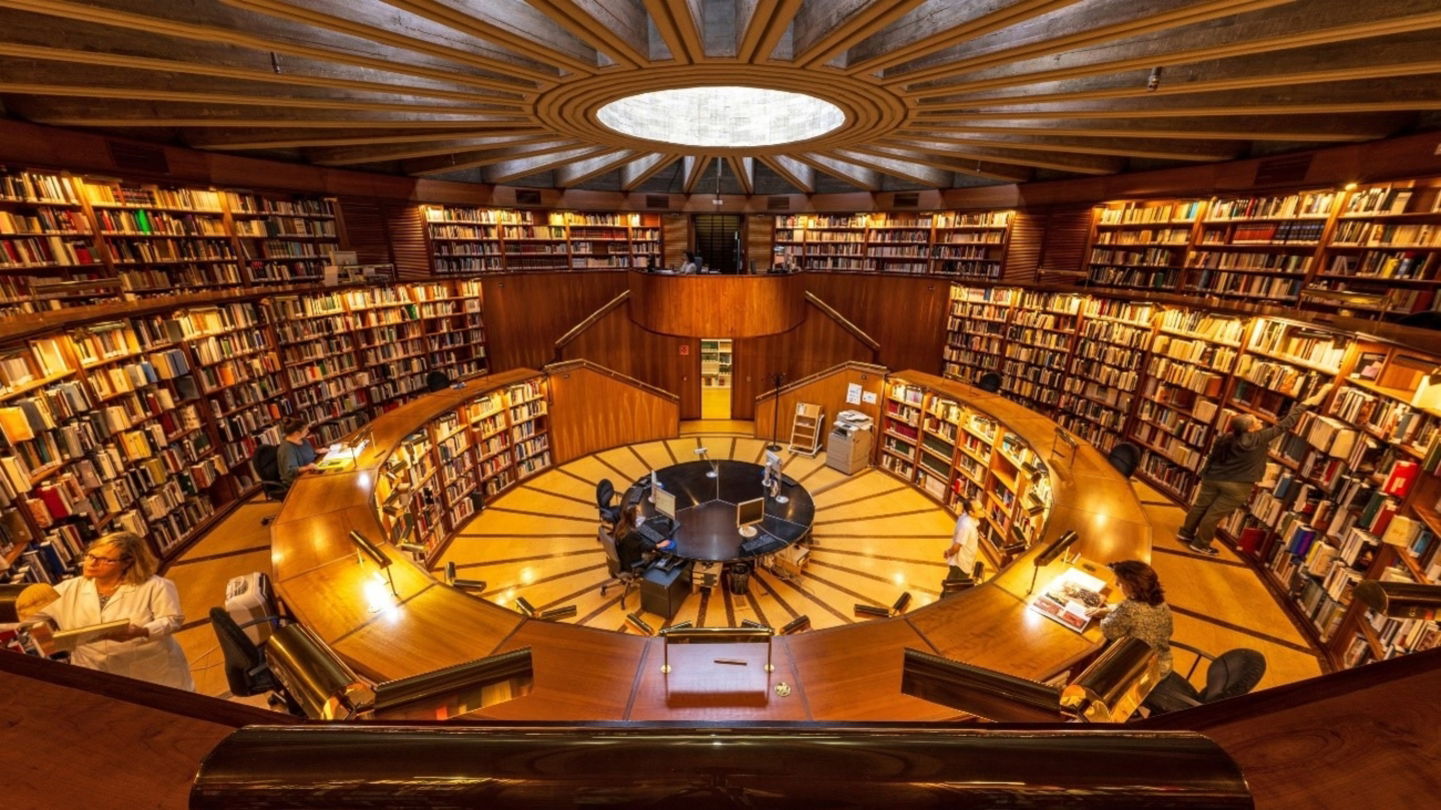

El problema va más allá, ya que se están multiplicando las menciones a publicaciones académicas inexistentes o a journals científicos ficticios en numerosos trabajos de investigación. Estas provienen claramente del empleo de IA sin verificación por parte de los investigadores, lo que erosiona la credibilidad de la ciencia en general y del acervo humano de conocimiento.

## Andrew Heiss, profesor en la Universidad Estatal de Georgia: “Las cosas generadas por IA se propagan en otras cosas reales, así que los estudiantes las ven citadas y asumen que son reales”

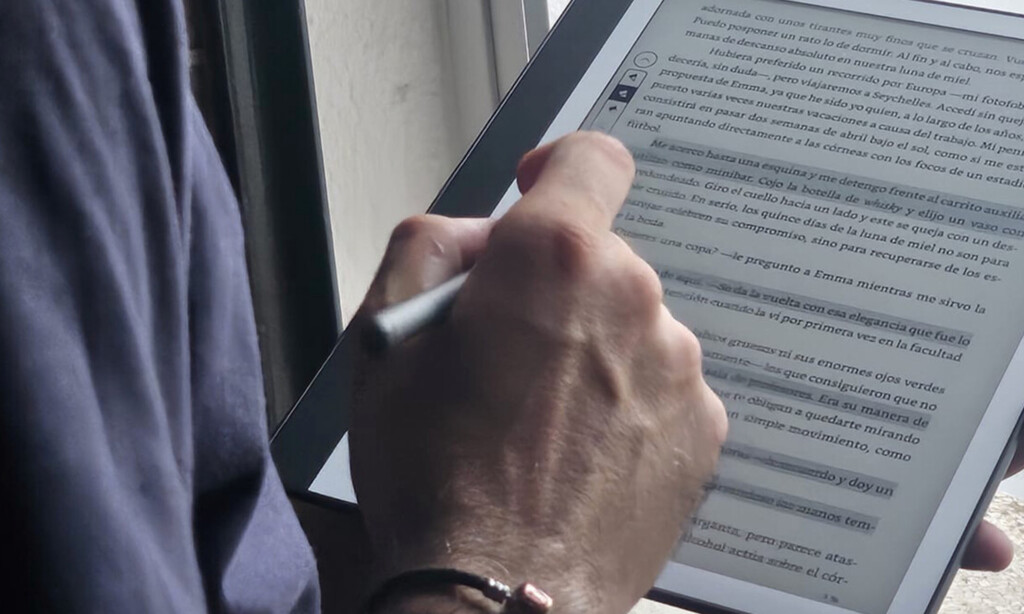

Esta situación salió a la luz en una entrevista con Andrew Heiss, profesor asistente en el Departamento de Gestión Pública y Políticas de la Andrew Young School of Policy Studies en la Universidad Estatal de Georgia. Mientras revisaba ensayos de sus alumnos hace unas semanas, detectó citas inusuales y referencias fabricadas a artículos académicos que no existían y que no guardaban relación con el contenido requerido para sustentar los trabajos.

Heiss señaló que había “muchos artículos generados por IA, que normalmente se nota y se retractan rápidamente”, especialmente en citas, gráficos e información producida por estos modelos. Además, al ampliar su búsqueda de referencias falsas en Google Scholar, descubrió que varios artículos de investigación ya publicados se apoyaban en descubrimientos o versiones de estudios y revistas inventados por la IA.

Esto genera fuentes que aparentan legitimidad pero que remiten a investigaciones inexistentes, lo que normaliza las fabricaciones de la IA, ya que muchos estudiantes e investigadores las encuentran y las consideran válidas, aunque en realidad no lo sean.

“Las cosas generadas por IA se propagan en otras cosas reales, así que los estudiantes las ven citadas en cosas reales y asumen que son reales, confundiéndose sobre por qué pierden puntos por usar fuentes falsas cuando otras fuentes reales las usan. Todo parece real y transparente.”

Es posible que, en lugar de facilitar la eficiencia, la IA nos conduzca en un futuro cercano a un escenario donde dediquemos más tiempo a validar las referencias al elaborar estudios y documentos.

La IA resulta muy persuasiva, ya que sus referencias siempre parecen auténticas, con nombres de académicos existentes o títulos que imitan la literatura real. En algunos casos, incluso incluyen autores verdaderos, aunque el título del artículo y la revista sean creaciones del modelo de IA.

“Los LLM son perniciosos porque, esencialmente, están contaminando el ecosistema de información aguas arriba. Las citas inexistentes aparecen en investigaciones que son descuidadas o deshonestas y de ahí llegan a otros artículos y artículos que las citan, y a otros que los citan, y luego se acaban en el agua. Es un resultado totalmente previsible de decisiones deliberadas.” Anthony Moser, ingeniero de software y tecnólogo.

En resumen, la IA ha saturado el panorama con investigaciones falsas y referencias inventadas, poniendo en riesgo de contaminación todo el conocimiento humano a través de estos modelos, lo que inicia un proceso que algunos investigadores más pesimistas llaman “la destrucción del conocimiento”.

El ingeniero y tecnólogo Anthony Moser es uno de ellos: “Me imagino a un profesor en algún lugar haciendo un programa de clases con ChatGPT, asignando lecturas de libros que no existen.”

La percepción es que los científicos ahora se enfrentan a una avalancha de información irrelevante, con una capacidad limitada para filtrarla, agravada por la presión de seguir publicando artículos que impulsen las líneas de investigación en curso.

Evidentemente, se requiere una integración más cautelosa de la IA para evitar la ingenuidad, pero está claro que en la actualidad resulta difícil confiar en cualquier dato, y será necesario invertir tiempo en verificar su autenticidad, examinando si las fuentes son confiables… ¡Es un panorama desalentador, pero en realidad era algo predecible!