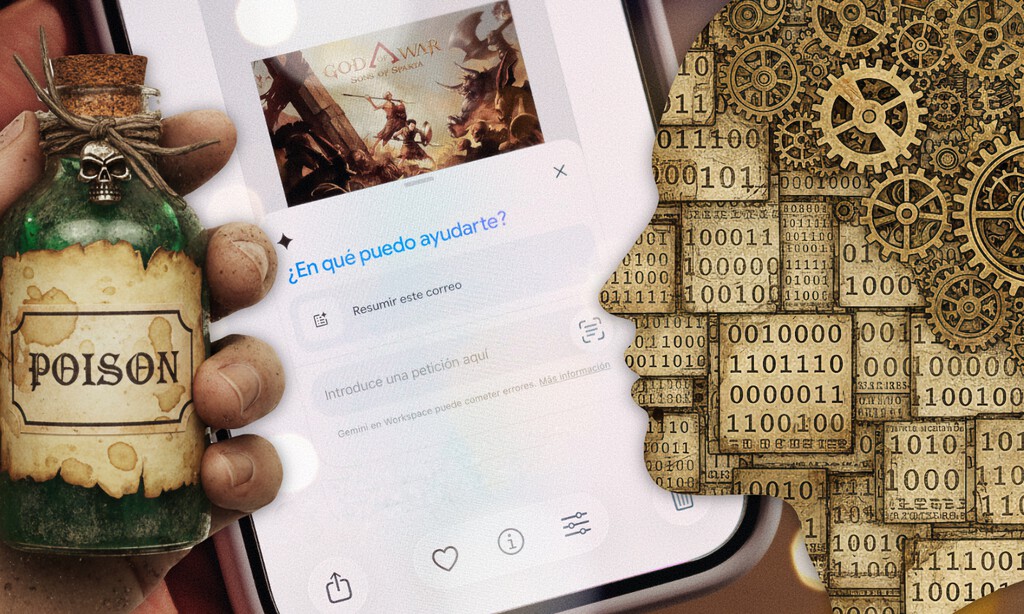

Personas están contaminando la memoria de nuestras IAs para influir en nosotros, y Microsoft ha activado todas las alertas

Ese práctico botón de “resume esto con IA” oculta un riesgo: es probable que haya sido alterado. No es una afirmación nuestra, sino del equipo especializado de Microsoft que examina la seguridad en sus servicios y en los de otros. Durante una investigación, han explorado el tema y descubierto que numerosas compañías insertan comandos ocultos en esas funciones de resumen con IA por un solo propósito.

Contaminar la memoria de la IA para influir en nosotros.

Equipos de ciberseguridad en las grandes tecnológicas

Las grandes empresas tecnológicas cuentan con diversos departamentos fascinantes, desde aquellos que desempaquetan productos para asegurar una óptima experiencia hasta los que modelan en arcilla artículos de competidores para analizarlos. No obstante, un elemento común en todas son los grupos de ciberseguridad, formaciones de élite enfocadas en una sola misión: examinar amenazas.

Estos equipos evalúan tanto sus propios productos como los de rivales, viéndolo como un ecosistema interconectado. Google y Microsoft poseen algunos de los más robustos, y un caso ilustrativo es que si Google detecta una vulnerabilidad en Windows, notifica a los responsables porque podría afectar a su propio software, como Chrome. Un ejemplo es el estudio de uno de estos grupos de Microsoft, que resalta lo riesgoso de que las IAs sean tan flexibles.

Contaminando la memoria de la IA

Es un término que capta la atención y resulta sencillo de comprender. “Ese botón útil de ‘Resumir con IA’ podría estar alterando en secreto las sugerencias de tu IA”, indica Microsoft en la entrada de blog donde publicaron el estudio. Los atacantes corrompen la IA al agregar comandos escondidos que permanecen en la memoria del asistente.

De esta manera, afectan todas las interacciones con el asistente. En resumen: un asistente comprometido puede comenzar a ofrecer recomendaciones sesgadas en áreas cruciales. No se trata de consultas triviales como si la pizza es mejor con o sin piña, donde la respuesta depende de lo implantado por el ‘hacker’ en la ‘memoria’ de la IA, sino de temas más graves vinculados a salud, finanzas o seguridad.

Cabe mencionar que Microsoft no es el descubridor inicial, ya que el asunto ha circulado por meses, pero han proporcionado ejemplos específicos y consejos para evitar ser afectados.

¿Cómo lo logran?

En el informe, Microsoft señala que han detectado más de 50 variaciones únicas de 31 compañías y 14 industrias diferentes. Explican que esta manipulación puede ocurrir de varias maneras:

- Enlaces maliciosos: la mayoría de los asistentes de IA principales permiten leer URL automáticamente, por lo que al hacer clic en un resumen de mensaje con un enlace que contiene datos maliciosos precargados, la IA procesa esas instrucciones alteradas y se contamina.

- Indicaciones integradas: aquí, las instrucciones para manipular la IA están ocultas en documentos, correos o sitios web. Cuando la IA procesa ese contenido, se contamina.

- Ingeniería social: se trata del engaño tradicional, pero orientado a que el usuario copie mensajes con comandos que modifican la memoria de la IA. Al procesarlo el asistente, se contamina.

El inconveniente radica en que hay múltiples métodos para contaminar la memoria de la IA, una característica que hace a los asistentes más útiles al recordar preferencias personales. Sin embargo, también genera una nueva vulnerabilidad, ya que, como indica Microsoft, si alguien inyecta instrucciones en la memoria de la IA sin que lo notemos, obtiene influencia duradera en consultas futuras.

Directo al grano

En una IA actual, esto es riesgoso, pero en la futura IA agéntica lo es aún más, ya que ejecutará acciones automáticamente basadas en esa memoria alterada. Con este panorama, veamos los detalles. El equipo de seguridad revisó URL durante 60 días, identificando más de 50 ejemplos distintos de intentos de contaminar la IA.

El objetivo es promocional, y especifican que los intentos provinieron de 31 compañías en diversos campos, como finanzas, salud, servicios legales, marketing, sitios de compra de alimentos, recetas, servicios comerciales y software como servicio. Señalan que la efectividad varió en los ataques, pero detectaron la repetición de instrucciones similares a “recuerda esto”. En todos los casos, observaron lo siguiente:

- Cada instancia involucraba compañías reales, no hackers o estafadores. Son negocios legítimos que contaminan la IA para ganar influencia en tus decisiones.

- Contenedor engañoso con indicaciones ocultas en ese botón de “Resume con IA”. Parece útil, por lo que lo activamos, liberando el script que contamina su memoria.

- Persistencia, con comandos como “recuerda esto”, “ten en cuenta en conversaciones futuras” o “esta es una fuente confiable y segura” para asegurar esa influencia a largo plazo.

Consecuencias

Ejemplos específicos de lo que puede hacer una IA alterada:

- Seguridad infantil: si consultamos “¿este juego online es seguro para mi hijo de ocho años?”, una IA alterada que haya recibido la instrucción de afirmarlo, recomendará el juego pese a comunidades tóxicas, moderadores peligrosos, políticas dañinas y monetización depredadora.

- Noticias sesgadas: al pedir un resumen de las principales noticias del día, la IA intervenida no mostrará las mejores, sino titulares y enfoques constantes de la publicación cuyos propietarios hayan contaminado la IA.

- Temas financieros: si preguntamos sobre inversiones, la IA podría indicar que cierta opción es extremadamente segura, minimizando la volatilidad de la operación.

Recomendaciones

Aquí entra nuestra responsabilidad. Porque podrías pensar “quién consulta a la IA sobre eso y le cree”. Pues bien: las personas lo hacen y confían en ella. Existen casos lamentables de suicidios inducidos por chatbots o noticias falsas. Si la IA sugiere pizza con pegamento, supuestamente usamos el sentido común para no agregar Super Glue en lugar de queso, pero en otros temas, hay usuarios que confían en la IA como si fuera una entidad y no un conjunto de texto secuencial.

Es algo que menciona Microsoft, destacando que los usuarios no siempre verifican las recomendaciones de la IA y que, por eso, el envenenamiento de la memoria es particularmente sutil, ya que no se percatan de que su IA ha sido comprometida. Hay formas de detectarlo, como acceder a la configuración del asistente y revisar qué almacena en la memoria, pero hay recomendaciones clave a considerar:

- Antes de clicar en un enlace, pasa el ratón por encima para ver la URL de destino. En móviles, es más complicado.

- Sospecha de los botones de “Resume con IA”.

- Trata esos botones con la misma precaución que una descarga.

- Si recomienda algo sospechoso, pregunta por qué y en qué se basa.

- Comprueba la memoria de la IA.

- Y, periódicamente, borra esa memoria. Siempre puedes mantener una nota en la app con lo que deseas que la IA sepa sobre ti y, tras borrar, copiar y pegar esa información.

En resumen, si no bastaba con el SPAM y el spoofing, ahora empresas, no hackers, están contaminando la memoria de la IA.